O Google comunicou nesta quinta-feira (7) que não usará sua tecnologia de inteligência artificial para criar armas ou métodos de monitoramento que violem os direitos humanos. O anúncio é uma resposta a uma carta assinada por mais de 4 mil funcionários que pediam o fim dos " negócios de guerra " da empresa .

Leia também: Vaza carta em que funcionários pedem fim dos "negócios de guerra" do Google

A pressão interna começou depois que o Google confirmou que tinha assinado um contrato com o Pentágono, o Departamento de Defesa dos Estados Unidos. Nesse contrato, a inteligência artificial criada pela empresa seria utilizada para interpretar vídeos e aumentar a precisão dos ataques de drones norte-americanos.

Funcionários atacam

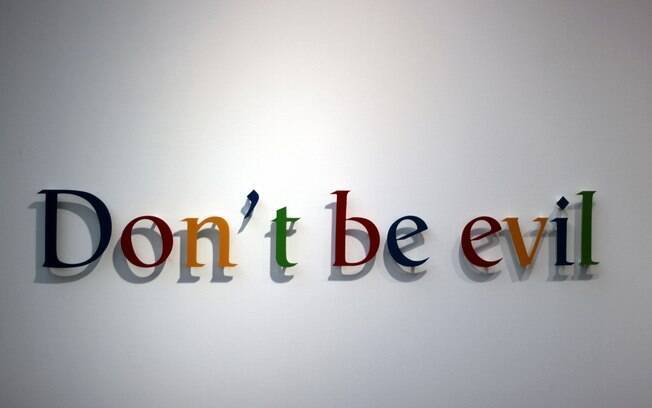

A decisão foi considerada pelos funcionários uma afronta aos princípios da empresa de trabalhar sempre em prol do bem-estar geral. Na carta endereçada aos líderes da companhia, entre eles o CEO Sundar Pichai, eles chegaram a citar um dos motes fixados na parede dos escritórios do Google nos Estados Unidos que diz "don't be evil", que significa "não seja mau".

A pressão inicial, porém, não surtiu efeito de modo que pelo menos 12 funcionários diretamente ligados ao Projeto Maven, que vem sendo tratado como os "negócios de guerra" do Google, pediram demissão . Um deles chegou a declarar que "em algum momento, percebi que sabendo o que eu sei, não poderia, de boa vontade, recomendar que alguém entrasse para o Google e então percebi que, se não posso recomendar às pessoas que trabalhem aqui, por que devo continuar?"

A partir daí, a comunidade internacional também começou a criticar o Google. Uma nova carta endereçada ao alto escalão da empresa já foi assinada por mais de 400 especialistas em inteligência artificial, além de pesquisadores e acadêmicos de várias partes do mundo.

Leia também: Funcionários se demitem em protesto contra "negócios de guerra" do Google

Google contra-ataca

Inicialmente, porém, o Google apenas se defendia dizendo que dando ao Pentágono acesso à sua biblioteca de código aberto para machine learning de modo a melhorar a identificação de objetos e pessoas em imagens capturaras pelos drones das forças armadas, o Google estaria ajudando a melhor a precisão dos ataque aéreos e mesmo os ataques terrestres de modo a, na verdade, ajudar a prevenir a morte de pessoas inocentes.

A resposta, porém, não deu fim aos protestos e exigiu um reforço no posicionamento da empresa. Agora, o Google garantiu que não renovará o contrato assinado com o Pentágono que expirará no ano que vem, além de não usar a inteligência artificial em "armas e outras tecnologias cujo principal objetivo ou implementação seja causar ou diretamente facilitar ferimentos em pessoas" ou para criar sistemas "que causem dano" e impedir que essa tecnolgoia "compile ou utilize informações de forma que viole normas internacionais aceitas".

O Google, porém, afirmou que continuará colaborando com governos em projetos militares dentro de áreas como cibersegurança, treinamento e recrutamento, antes de divulgar uma lista de sete de regras para o uso apropriado da tecnologia de inteligência artificial nas plataforma da empresa que incluem:

- Ser socialmente benéficas;

- Evitar criar ou reforçar preconceitos;

- Ser construídas com segurança e testadas antes;

- Poder ser alvo de escrutínio pelas pessoas;

- Incorporar princípios de privacidade ao serem desenhadas;

- Garantir excelência científica;

- Ser disponibilizada ao público apenas se seguir esses princípios.

Vale ressaltar que a inteligência artificial parece mesmo estar no cerne do projeto de futuro do Google.

Em conferência anual para desenvolvedores da empresa realizada no mês passado, a Google I/O 2018, a principal novidade anunciada foi o aprimoramento da assistente virtual da empresa na futura nova versão do sistema operacional da empresa , provisoriamente chamado de Android P.

Leia também: Assistente pessoal do Google vai ser capaz de fazer ligações por você sozinha

No vídeo divulgado durante a apresentação, o Google mostra como através de técnicas de machine learning com inteligência artificial fez sua assistente se tornar capaz de fazer ligações e conversas com humanos sozinha de modo a marca consultas médicas, cortes de cabelo e fazer reservas em restaurantes por você.