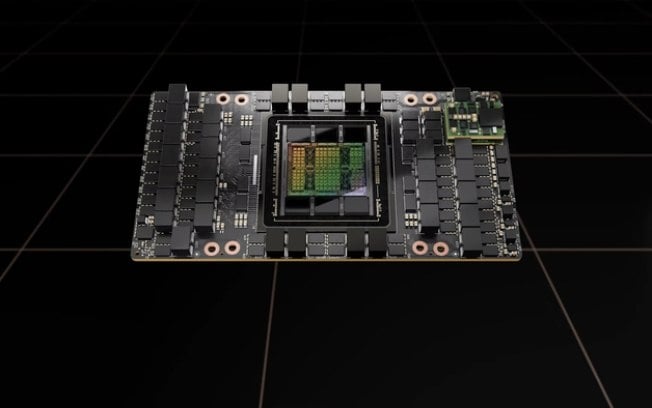

Segundo analistas de mercado, a infraestrutura de Inteligência Artificial com GPUs Nvidia tem consumo de eletricidade equivalente ao de alguns países. As estimativas para 2024 são de aproximadamente 3,5 milhões de unidades H100 operando em servidores de IA, consumindo aproximadamente 13.000 GWh por ano, mais do que a média de países como Guatemala e Lituânia.

- Era da IA nos PCs | As projeções da Intel para 2024 e além

- AMD Hawk Point x Intel Meteor Lake: qual é a melhor CPU com IA

A Nvidia ainda domina praticamente todo o segmento de IA, uma vez que apenas recentemente Intel e AMD começaram a trazer produtos realmente competitivos para esse mercado. No entanto, a eficiência energética vem sendo um dos pontos mais levantados pelas duas empresas, apresentando soluções com níveis de consumo distribuídos em escala para diferentes tipos e níveis de operação.

By next year, Nvidia's ~3.5 million units of deployed H100 GPUs will consume a whopping 13,000 GWh of electricity annually, which is greater than the power consumption of some entire countries like Guatamela and Lithuania.

-

— Stock Talk (@stocktalkweekly) December 27, 2023

Feedly: assine nosso feed RSS e não perca nenhum conteúdo do Canaltech em seu agregador de notícias favorito.

-

Otimizando consumo energético

O alto consumo de energia de serviços de IA se justifica por praticamente todos eles estarem, quase que exclusivamente, vinculados à operação em nuvem. Naturalmente, treinar modelos LLM de bilhões de parâmetros obrigatoriamente exige dessa infraestrutura, mas ela também acaba sendo utilizada por serviços sob demanda para os setores consumidor e corporativo por falta de alternativas melhor dimensionadas.

Especificamente no caso da Intel , a empresa está adotando a estratégia de diversificar e pulverizar IA em todos os segmentos de mercado. Enquanto as GPUs Gaudi 2 e Gaudi 3 miram em competir com as H100, H200 e as próximas placas Blackwell, os Xeon de 5ª geração com aceleradores de IA embarcados em todos os núcleos focam em soluções apenas via CPU .

Exascale #Supercomputing Is Coming to Stuttgart: Hunter will be based on the AMD Instinct MI300A accelerated processing unit (APU). This will slash the energy required to operate Hunter by approximately 80% at peak performance and will raise peak performance to 39 petaFLOPS. https://t.co/o6mv4xYdh5

— AMD (@AMD) December 19, 2023

Com isso, é possível atuar tanto na infraestrutura profunda de servidores remotos, quanto em produtos com capacidade dimensionada sob demanda de treinamento e inferência local, sem necessidade de conectividade. Ao que tudo indica, a AMD também está optando pela mesma estratégia com as GPUs Instinct MI300 e a tecnologia Ryzen AI embarcada nos novos produtos com arquitetura Hawk Point .

Em ambos os casos, a intenção é reduzir ao máximo a dependência dos serviços exclusivamente em nuvem, reduzindo o custo total de operação (TCO) para clientes de todos os níveis.

🛒 Compre placas Nvidia GeForce RTX pelo melhor preço!

🛒 Compre placas AMD Radeon RX pelo melhor preço!

Leia a matéria no Canaltech .

Trending no Canaltech:

- O campo magnético da Terra está prestes a ser revertido?

- Mamonas Assassinas | Compare o elenco do filme com as pessoas reais

- Peugeot 208 Turbo x Volkswagen Polo Highline: Qual é o melhor hatch turbo?

- As 10 melhores séries da Netflix em 2023

- Inteligência artificial prevê data da morte com 74% de precisão

- 🚨COM CUPOM | Aproveite Galaxy S22 de 256 GB em preço imperdível